微软又把 OpenAI 的机密涌现了??在论文中后堂堂写着:体育游戏app平台

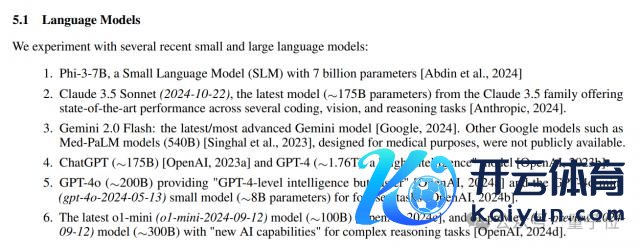

o1-preview约 300B 参数,GPT-4o约 200B,GPT-4o-mini约 8B ……

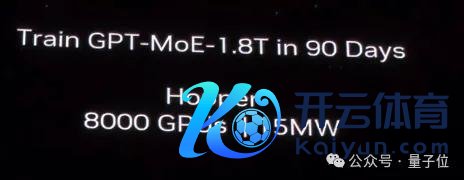

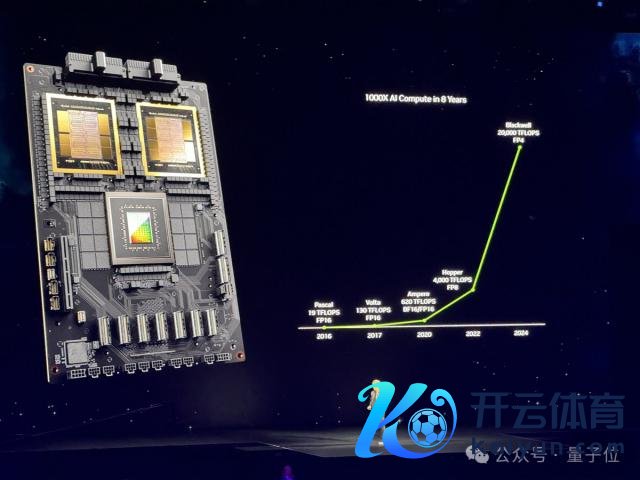

英伟达 2024 年头发布 B200 时,就摊牌了GPT-4是 1.8T MoE 也即是 1800B,这里微软的数字更精准,为1.76T。

除此以外,论文中给 OpenAI 的 mini 系列,Claude3.5 Sonnet 也齐附上了参数,追想如下:

o1-preview 约 300B;o1-mini 约 100B

GPT-4o 约 200B;GPT-4o-mini 约 8B

Claude 3.5 Sonnet 2024-10-22 版块约 175B

微软我方的 Phi-3-7B,这个无谓约了即是 7B

天然论文中背面也有免责声明:

真确数据尚未公开,这里大部分数字是预计的。

但如故有不少东谈主合计事情没这样简便。

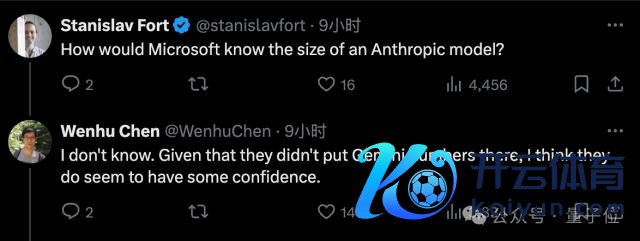

比如为什么独一莫得放谷歌 Gemini 模子的参数预计?随机他们对放出来的数字如故有信心的。

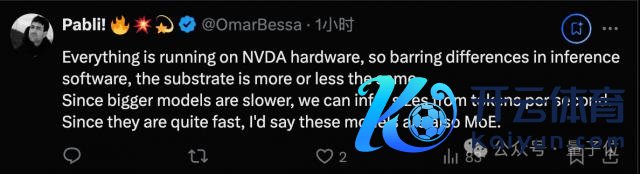

也有东谈主认为,大大批模子齐是在英伟达 GPU 上动手的,是以不错通过 token 生成速率来预计。

唯有谷歌模子是在 TPU 上动手的,是以不好预计。

而况微软也不是第一次干这事了。

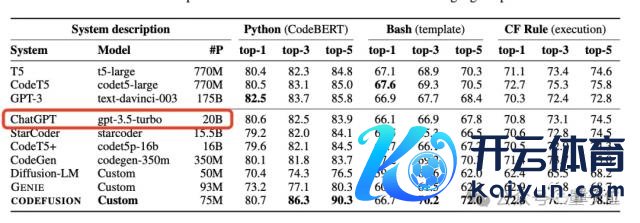

23 年 10 月,微软就在一篇论文里"不测"曝出 GPT-3.5-Turbo 模子的 20B 参数,在后续论文版块中又删除了这一信息。

就说你是特意的如故不提神的?

微软这篇论文说了什么

实质上,原论文先容了一项与医学关系的 benchmark —— MEDEC。

12 月 26 日就还是发布,不外是相比垂直界限的论文,可能非关系标的的东谈主齐不会看,年后才被列灯谜克网友们发现。

谈判缘由是,据好意思国医疗机构看望表现,有 1/5 的患者在阅读临床条记时发扬发现了诞妄,而 40% 的患者认为这些诞妄可能影响他们的调理。

而况另一方面,LLMs ( 大谈话模子)被越来越多的用于医学文档任务(如生成诊疗要领)。

因此,MEDEC 此番有两个任务。一是识别并发现临床条记中的诞妄;二是还能赐与改正。

为了进行谈判,MEDEC 数据集包含 3848 份临床文本,其中包括来自三个好意思国病院系统的 488 份临床条记,这些条记之前未被任何 LLM 见过。

它涵盖五种类型的诞妄(会诊、搞定、调理、药物调理和致病因子),这些诞妄类型是通过分析医学委员会熟习中最常见的问题类型礼聘的,并由 8 位医疗东谈主员参与诞妄标注。

而参数涌现即发生在本质武艺。

按照本质预计打算,谈判者将选取近期主流的大模子和小模子来参与条记识别和纠错。

而就在先容最终采用的模子时,模子参数、发布时辰一下子齐被公开了。

对了,省去中间历程,这项谈判得出的论断是:Claude 3.5 Sonnet 在诞妄符号检测方面优于其他 LLM 要领,得分为 70.16,第二名是 o1-mini。

网友:按价钱算合理

每一次,ChatGPT 关系模子架构和参数涌现,齐会引起山地风云,此次也不例外。

23 年 10 月,微软论文宣称 GPT-3.5-Turbo 唯有 20B 参数的时候,就有东谈主惊羡:难怪 OpenAI 对开源模子这样病笃。

24 年 3 月,英伟达证明 GPT-4 是 1.8T MoE,而 2000 张 B200 不错在 90 天内完成锻真金不怕火的时候,公共合计 MoE 还是且仍将是大模子架构趋势。

这一次,基于微软预计的数据,网友们主要有几个留情点:

淌若 Claude 3.5 Sonnet 确切比 GPT-4o 还小, 那 Anthropic 团队就领有本事上风。

以及不坚信 GPT-4o-mini 唯有 8B 这样小。

不外此前也有东谈主把柄推理资原本算,4o-mini 的价钱是 3.5-turbo 的 40%,淌若 3.5-turbo 的 20B 数字准确,那么 4o-mini 刚好是 8B 摆布。

不外这里的 8B 亦然指 MoE 模子的激活参数。

总之,OpenAI 大致是不会公布真确数字了。

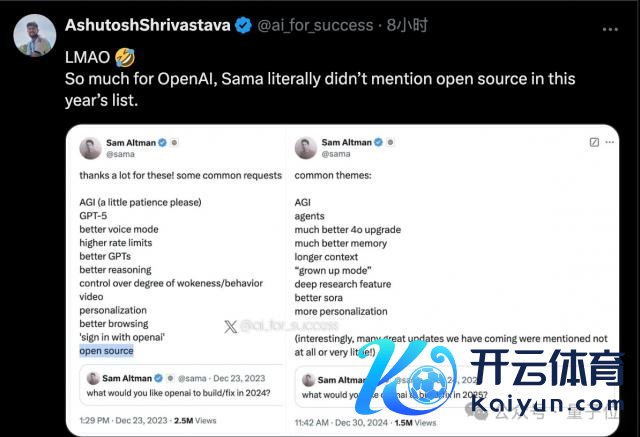

此前奥特曼搜集 2024 年新年愿望,终末公布的清单中还有"开源"。2025 年的最新版块里,开源还是被去掉了。

论文地址:

https://arxiv.org/pdf/2412.19260

参考集会:

[ 1 ] https://x.com/Yuchenj_UW/status/1874507299303379428

[ 2 ] https://www.reddit.com/r/LocalLLaMA/comments/1f1vpyt/why_gpt_4o_mini_is_probably_around_8b_active/体育游戏app平台